| Version 2 (modified by waue, 16 years ago) (diff) |

|---|

零. 前言

- 開發hadoop 需要用到許多的物件導向語法,包括繼承關係、介面類別,而且需要匯入正確的classpath,否則寫hadoop程式只是打字練習...

- 用類 vim 來處理這種複雜的程式,有可能會變成一場惡夢,因此用eclipse開發,搭配mapreduce-plugin會事半功倍。

- 早在hadoop 0.19~0.16之間的版本,筆者就試過各個plugin,每個版本的plugin都確實有大大小小的問題,如:hadoop plugin 無法正確使用,目前測試最穩定的對應是 Eclipse 3.3.2 + Hadoop 0.18~0.20 的 plugin

- 注:Eclipse 3.4~3.5 搭配 hadoop-eclipse-plugin (於 Ubuntu 平台)會有無法 run on hadoop 的問題!

- Last Update: 2010/09/24

0.1 環境說明

- Ubuntu 10.04

- sun-java-6

- Eclipse 3.3.2

- hadoop 0.20.2

0.2 目錄說明

- 使用者:waue

- 使用者家目錄: /home/hadooper

- 專案目錄 : /home/hadooper/workspace

- hadoop目錄: /opt/hadoop

一、安裝

安裝的部份沒必要都一模一樣,僅提供參考,反正只要安裝好java , hadoop , eclipse,並清楚自己的路徑就可以了

1.1. 安裝java

首先安裝java 基本套件

$ sudo apt-get install java-common sun-java6-bin sun-java6-jdk sun-java6-jre

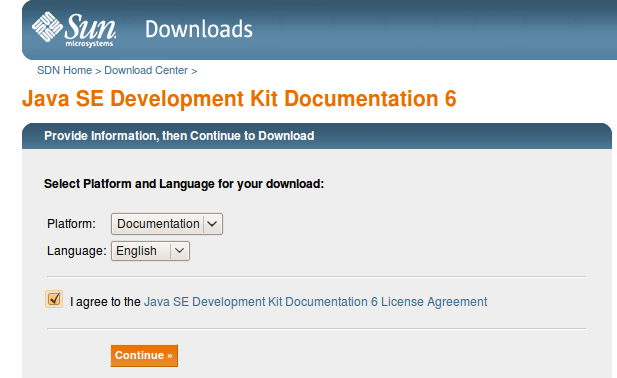

1.1.1. 安裝sun-java6-doc

1 將javadoc (jdk-6u10-docs.zip) 下載下來 下載點

2 下載完後將檔案放在 /tmp/ 下

3 執行

$ sudo apt-get install sun-java6-doc

1.2. ssh 安裝設定

$ apt-get install ssh $ ssh-keygen -t rsa -P '' -f ~/.ssh/id_rsa $ cat ~/.ssh/id_rsa.pub >> ~/.ssh/authorized_keys $ ssh localhost

執行ssh localhost 沒有出現詢問密碼的訊息則無誤

1.3. 安裝hadoop

安裝hadoop0.20到/opt/並取目錄名為hadoop

$ cd ~ $ wget http://apache.ntu.edu.tw/hadoop/core/hadoop-0.20.2/hadoop-0.20.2.tar.gz $ tar zxvf hadoop-0.20.2.tar.gz $ sudo mv hadoop-0.20.2 /opt/ $ sudo chown -R waue:waue /opt/hadoop-0.20.2 $ sudo ln -sf /opt/hadoop-0.20.2 /opt/hadoop

- 編輯 /opt/hadoop/conf/hadoop-env.sh

export JAVA_HOME=/usr/lib/jvm/java-6-sun export HADOOP_HOME=/opt/hadoop export PATH=$PATH:/opt/hadoop/bin

- 編輯 /opt/hadoop/conf/core-site.xml

<configuration>

<property>

<name>fs.default.name</name>

<value>hdfs://localhost:9000</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/tmp/hadoop/hadoop-${user.name}</value>

</property>

</configuration>

- 編輯 /opt/hadoop/conf/mapred-site.xml

<configuration>

<property>

<name>mapred.job.tracker</name>

<value>localhost:9001</value>

</property>

</configuration>

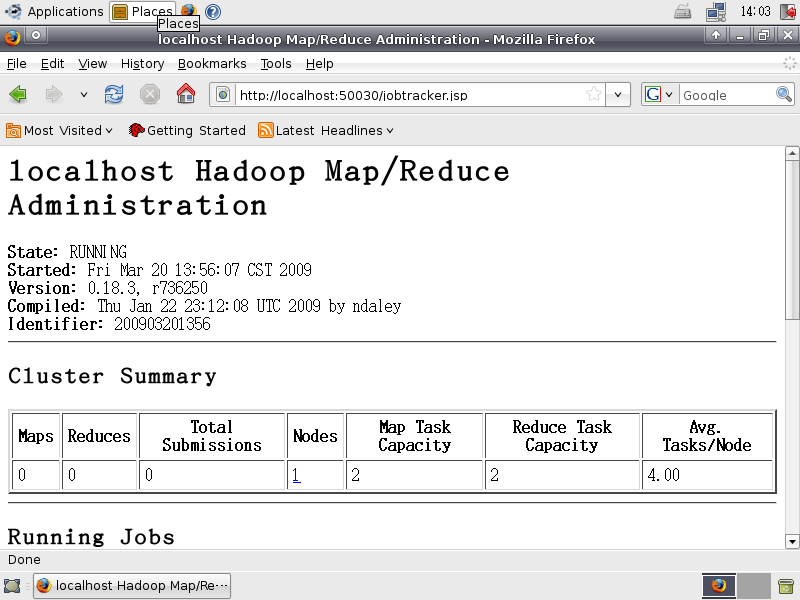

- 啟動

$ cd /opt/hadoop $ source /opt/hadoop/conf/hadoop-env.sh $ hadoop namenode -format $ start-all.sh $ hadoop fs -put conf input $ hadoop fs -ls

- 沒有錯誤訊息則代表無誤

1.4. 安裝eclipse

- eclipse 檔已下載到家目錄後,執行下面指令:

$ cd ~ $ wget http://secuse.nchc.org.tw/class/eclipse-SDK-3.3.2-linux-gtk.tar.gz $ tar -zxvf eclipse-SDK-3.3.2-linux-gtk.tar.gz $ sudo mv eclipse /opt $ sudo ln -sf /opt/eclipse/eclipse /usr/local/bin/

二、 建立專案

2.1 安裝hadoop 的 eclipse plugin

- 匯入hadoop 0.20.2 eclipse plugin

$ cd /opt/hadoop $ sudo cp /opt/hadoop/contrib/eclipse-plugin/hadoop-0.20.2-eclipse-plugin.jar /opt/eclipse/plugins

$ sudo vim /opt/eclipse/eclipse.ini

- 可斟酌參考eclipse.ini內容(非必要)

-showsplash org.eclipse.platform -vmargs -Xms80m -Xmx512m

2.2 開啟eclipse

- 打開eclipse

$ eclipse &

一開始會出現問你要將工作目錄放在哪裡:在這我們用預設值

PS: 之後的說明則是在eclipse 上的介面操作

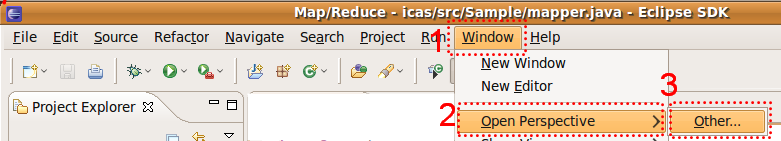

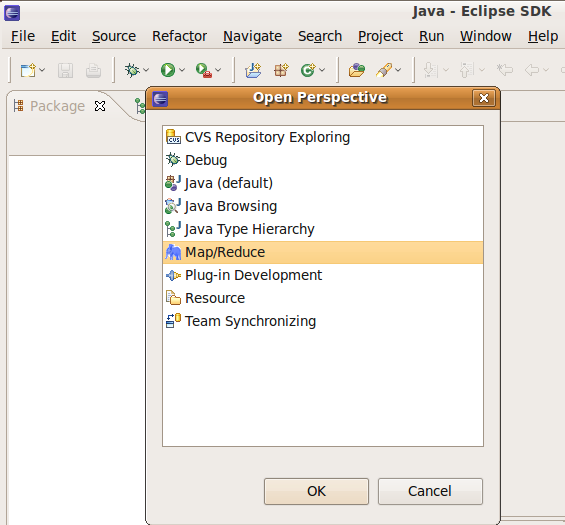

2.3 選擇視野

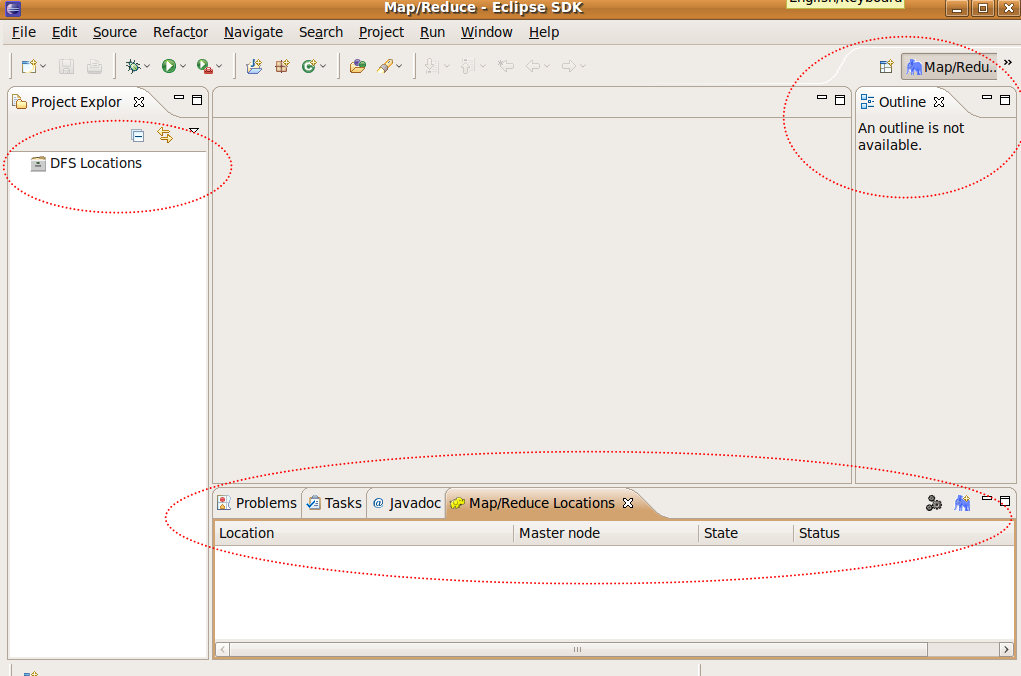

| window -> | open pers.. -> | other.. -> | map/reduce |

設定要用 Map/Reduce? 的視野

使用 Map/Reduce? 的視野後的介面呈現

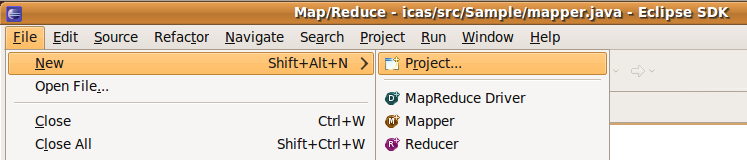

2.4 建立專案

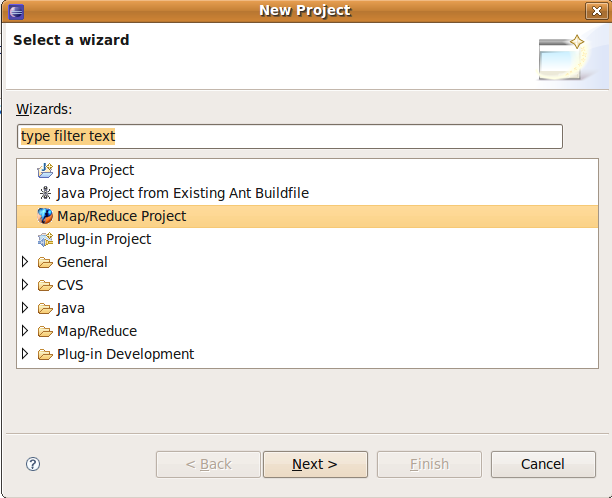

file -> new -> project -> Map/Reduce? -> Map/Reduce? Project -> next

建立mapreduce專案(1)

建立mapreduce專案的(2)

project name-> 輸入 : icas (隨意) use default hadoop -> Configur Hadoop install... -> 輸入: "/opt/hadoop" -> ok Finish

2.5 設定專案

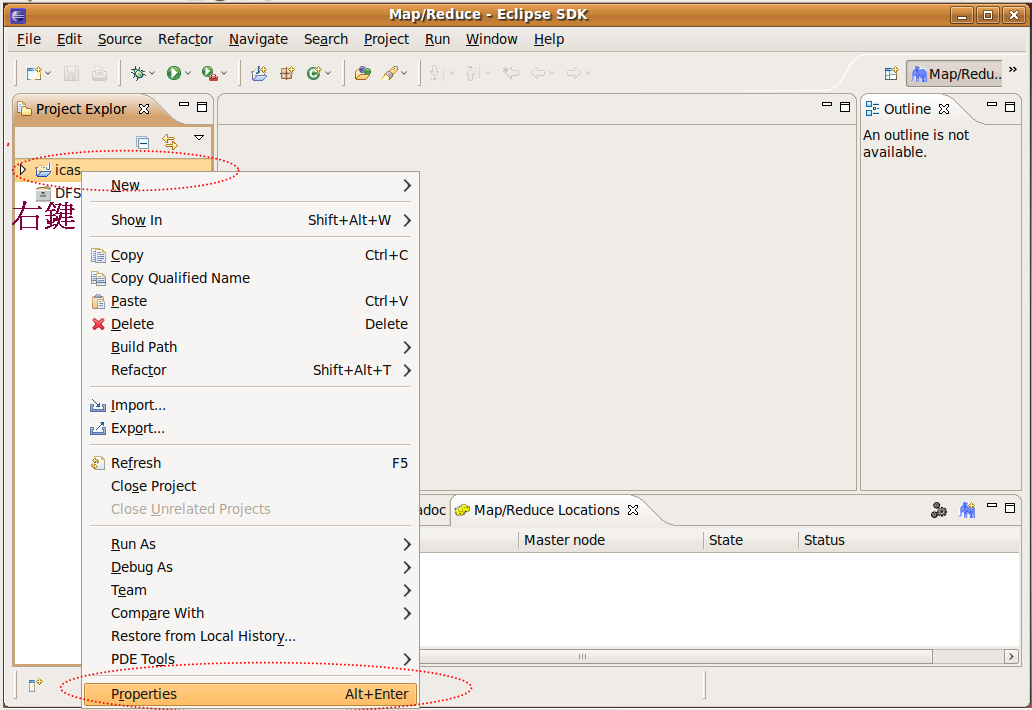

由於剛剛建立了icas這個專案,因此eclipse已經建立了新的專案,出現在左邊視窗,右鍵點選該資料夾,並選properties

Step1. 右鍵點選project的properties做細部設定

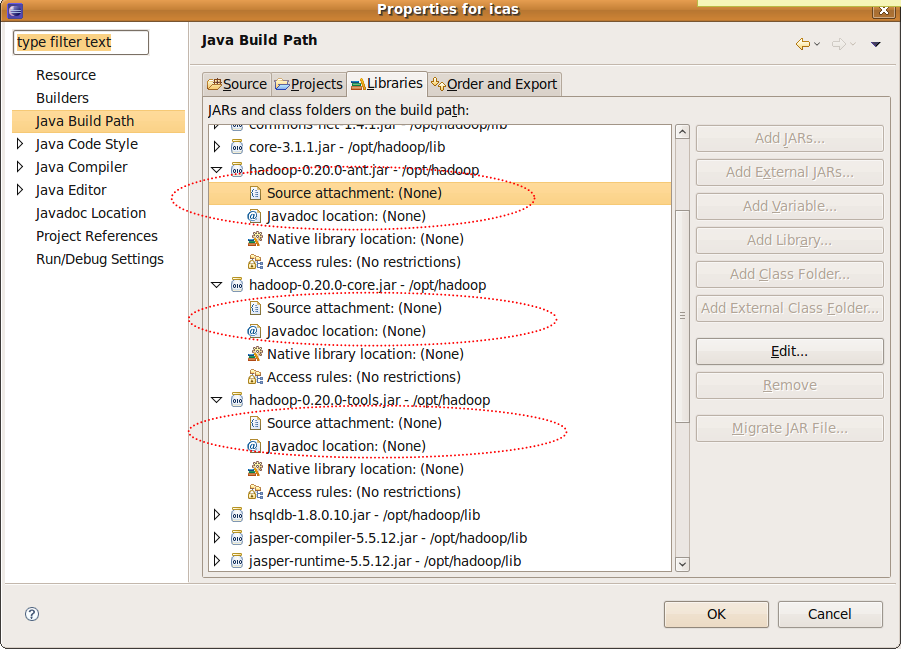

Step2. 進入專案的細部設定頁

- java Build Path -> Libraries -> hadoop-0.20.2-ant.jar

- java Build Path -> Libraries -> hadoop-0.20.2-core.jar

- java Build Path -> Libraries -> hadoop-0.20.2-tools.jar

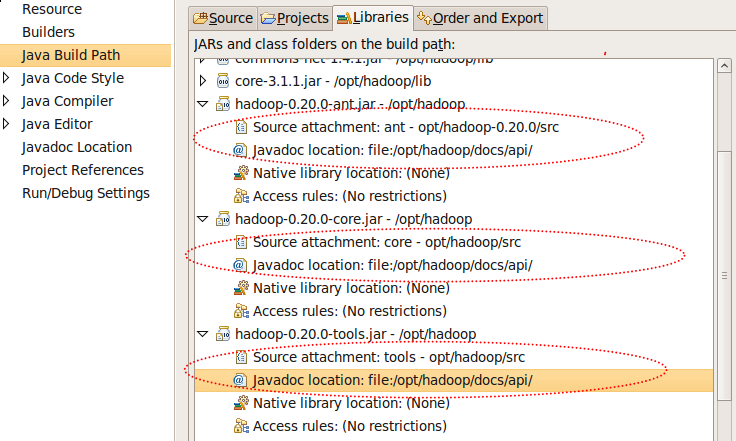

- 以 hadoop-0.20.2-core.jar 的設定內容如下,其他依此類推

source ...-> 輸入:/opt/opt/hadoop-0.20.2/src/

javadoc ...-> 輸入:file:/opt/hadoop/docs/api/

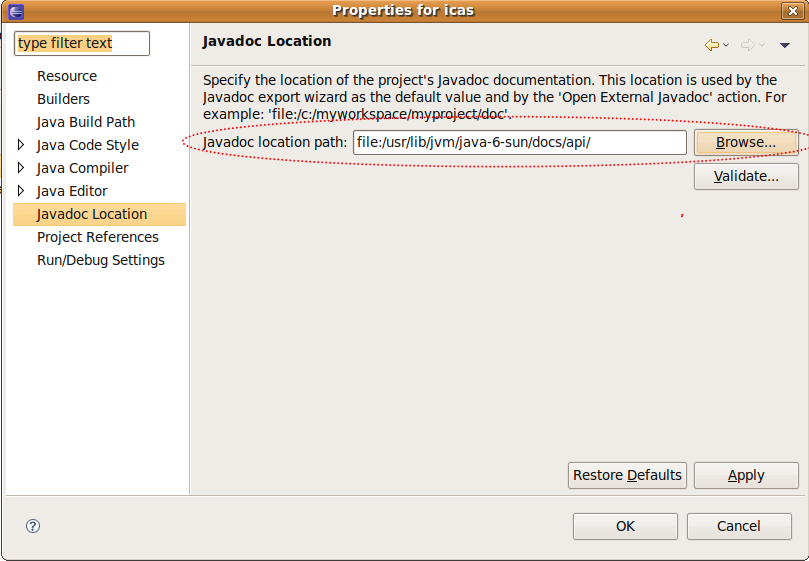

Step3. hadoop的javadoc的設定完後(2)

Step4. java本身的javadoc的設定(3)

- javadoc location -> 輸入:file:/usr/lib/jvm/java-6-sun/docs/api/

設定完後回到eclipse 主視窗

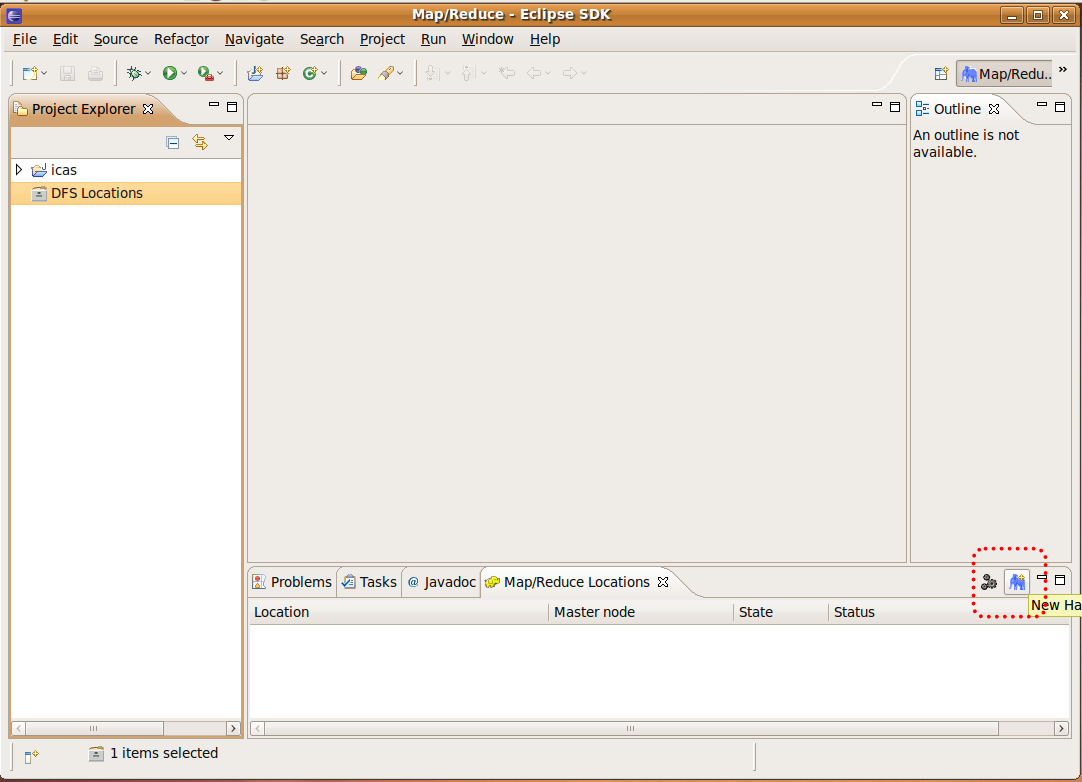

2.6 連接hadoop server

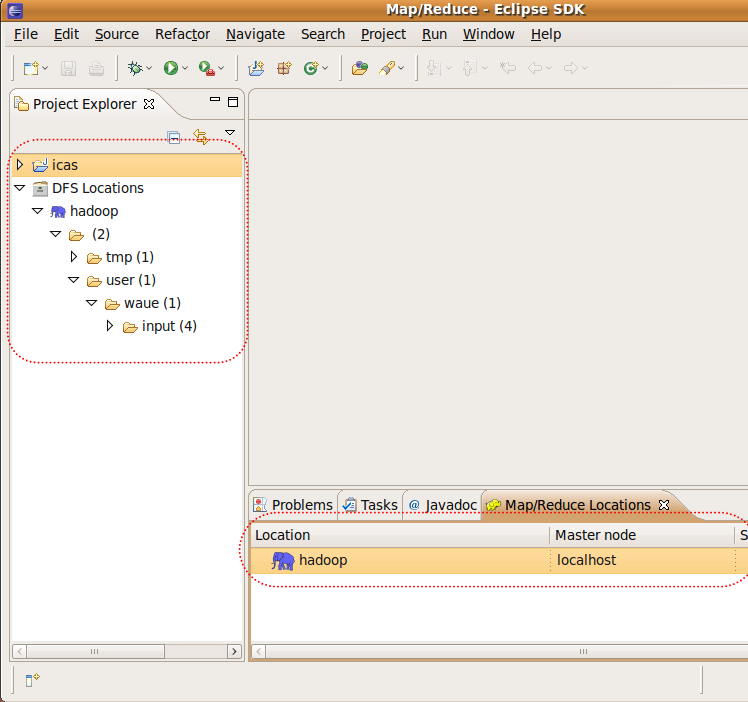

Step1. 視窗右下角黃色大象圖示"Map/Reduce? Locations tag" -> 點選齒輪右邊的藍色大象圖示:

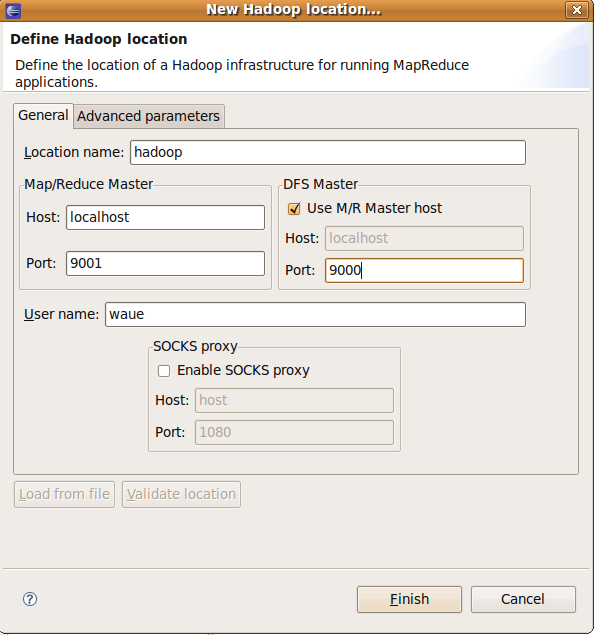

Step2. 進行eclipse 與 hadoop 間的設定(2)

Location Name -> 輸入:hadoop (隨意) Map/Reduce Master -> Host-> 輸入:localhost Map/Reduce Master -> Port-> 輸入:9001 DFS Master -> Host-> 輸入:9000 Finish

設定完後,可以看到下方多了一隻藍色大象,左方展開資料夾也可以秀出在hdfs內的檔案結構

三、 撰寫範例程式

- 之前在eclipse上已經開了個專案hadoop020,因此這個目錄在:

- /home/hadooper/workspace/hadoop020

- 在這個目錄內有兩個資料夾:

- src : 用來裝程式原始碼

- bin : 用來裝編譯後的class檔

- 如此一來原始碼和編譯檔就不會混在一起,對之後產生jar檔會很有幫助

五、結論

- 搭配eclipse ,我們可以更有效率的開發hadoop

- hadoop 0.20 與之前的版本api以及設定都有些改變,因此hadoop 環境的設定,需要看hadoop 0.20 的quickstart; 而如何使用 hadoop 0.20 的api,則可以看 /opt/hadoop/src/example/ 裡面的程式碼來提供初步的構想